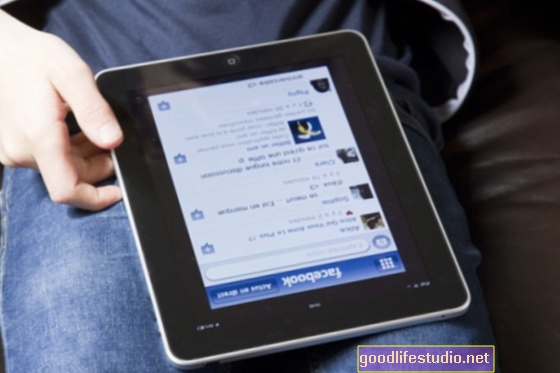

Titkos dokumentumok: A Facebook úgy tűnik, hogy a szolgáltatásokat jobbá teszi, és profitot jelent a felhasználók biztonsága felett

A Facebook, a 13 éves behemót 1,23 milliárd aktív felhasználóval, több mint 8 milliárd dollár bevételt generál negyedévente - ebből 3 milliárd dollár nettó jövedelem (például nyereség).

De a sok felhasználó mellett a Facebook úgy tűnik, hogy a felhasználói biztonságot másodlagos kérdésnek vetette alá. Az év elejéig a Facebook csak 4500 embert alkalmazott a tartalom felülvizsgálatához. Ami sok embernek hangzik, amíg rájössz, hogy az 1,23 milliárd aktív felhasználó osztozik milliárdokat tartalom darabjait naponta, több millió felhasználói panaszt tettek nap mint nap a Facebook tartalommal kapcsolatban.

Komoly felhasználói biztonsági probléma van a Facebook-on? Egy most megjelent Gyám titkos, belső dokumentumok áttekintése azt sugallja, hogy problémája nem kontrollálható.

A Facebook elismerte, hogy valamiféle problémája van, amikor az év elején vállalta, hogy majdnem megduplázza a felülvizsgálati személyzetet - 7500-ig - azon állítások közepette, hogy a vállalat egyszerűen nem tesz (vagy talán nem törődik vele) eléggé, ha potenciálisan káros tartalmat forgalmaznak az egész platformján . Nem duplázod meg moderáló személyzetedet, ha minden vaskos.

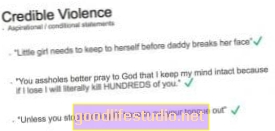

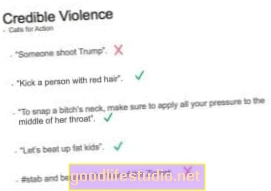

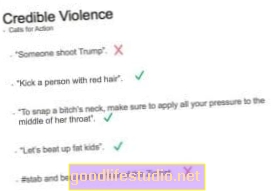

Most, Az (Egyesült Királyság) gyámja meghökkentő részleteket tett közzé a Facebook tartalom moderálási irányelveiről, több mint 100 titkos, belső képzési kézikönyv és dokumentáció alapján. Kicsit zavaró, hogy ezek a fontos dolgok nincsenek egyetlen kézikönyvben, amelyet a Facebook moderátorai kapnak, amikor felveszik őket.Ehelyett nagyon soknak tűnik a politika részleges megközelítésének, amelynek eredményeként ellentmondásos információknak, egyenetlen mértékletességnek és kevéssé megbízhatónak tűnik az, hogy a moderáló politikája valójában hogyan működik.

"A Facebook nem tudja ellenőrizni a tartalmát" - mondta az egyik forrás. - Túl nagyra nőtt, túl gyorsan.

Sok moderátornak állítólag aggályai vannak az egyes politikák következetlenségével és sajátos jellegével kapcsolatban. Például a szexuális tartalommal rendelkezők a legösszetettebbek és a legzavaróbbak.

Csak egy apró példa arra, hogy a Facebook mennyire moderál moderált tartalmat, a cikkek megjegyzik: "Egy dokumentum szerint a Facebook hetente több mint 6,5 millió jelentést vizsgál át potenciálisan hamis számlákról - FNRP néven (hamis, nem valódi személy)." És ez csak a hamis számlákra vonatkozik. Képzelje el, hány millió további jelentés vonatkozik a tényleges tartalomra.

Jellemzők a gondolkodás előtt

Mielőtt elgondolkodnának azon, hogy az emberek hogyan használhatják (és visszaélhetnek) egy új funkcióval, a Facebook úgy tűnik, hogy előnyben részesíti a dolgok kigördülését és annak utólagos kitalálását. Nézze meg a Facebook Live szolgáltatást, egy video streaming szolgáltatást, amely lehetővé teszi az emberek számára, hogy videóra bocsássák az életük pillanatnyi eseményeit. Mit gondoltak, az emberek végül mire használják?

Ez azt mutatja, hogy következetesen nem gondolják át a problémákat, és proaktív módon foglalkoznak velük, mielőtt azok felmerülnének. Vagy téved a következő oldalon: "Hé, tekerjünk ezzel és nézzük meg, milyen felháborodást kap, mielőtt bármit is tennénk ellene." (Mindezt természetesen a „szólásszabadság” nevében, figyelmen kívül hagyva azt a tényt, hogy a Facebook globális platform.) 1

Hová tettem újra ezt a moderációs irányelvet?

És talán mindet egyetlen kézikönyvbe helyezi? Tehát a moderátorok tudják, hol kell keresni, és minden iránymutatás következetes legyen?

Az önkárosító videók teljesen rendben vannak a Facebook világában, mert az illető „szorongásban van”. Így az állati kegyetlenség is (talán azért, mert az állat szorongásban van?). A „bosszú pornó” szintén rendben van, ha a moderátor nem tudja megerősíteni mindkét fél beleegyezésének hiányát (ezt elképzeléseim szerint elég nehéz lehet időben végrehajtani).

"A nem szexuális fizikai bántalmazásról és a gyermekek megfélemlítéséről készült néhány fényképet nem kell törölni vagy" cselekedni ", hacsak nincs szadista vagy ünnepi elem." Amíg a szadizmust és az ünnepeket kizárja erőszakos képeiből és videóiból, a Facebook nyilvánvalóan megengedi nekik.

A dokumentumok szerint „Az erőszakos halálesetekről készült videók zavaróak, de segíthetnek a figyelem felkeltésében. A videók esetében úgy gondoljuk, hogy a kiskorúaknak védelemre van szükségük, a felnőtteknek pedig választaniuk kell. "Zavaró" videókként jelöljük meg az emberek erőszakos halálát. " Nem világos, hogy az öngyilkos tartalom - például élő videók vagy fenyegetések - hová tartoznak a Facebook moderációs irányelveiben, de úgy tűnik, hogy megengedett.

A Facebooknak prioritásként kell kezelnie a felhasználói biztonságot

Egyesek a Facebook szigorúbb szabályozását szorgalmazták, mivel ez az összes tartalom kapuja (hasonlóan a televíziós műsorszolgáltatóhoz a hálózaton belüli tartalom kapuja):

A brit képviselők május 1-jén közzétett jelentése szerint „a legnagyobb és leggazdagabb közösségi média-vállalatok szégyenteljesen távol állnak attól, hogy elegendő lépést tegyenek az illegális vagy veszélyes tartalom leküzdése, a megfelelő közösségi normák végrehajtása vagy a felhasználók biztonságának megőrzése érdekében”.

A „szólásszabadság” oldalán való tévedés jó ötletnek tűnhet, különösen egy amerikai vállalat számára. De a közösségi hálózatok elsősorban online közösségek - nem nagyon hasonlítanak az újságokhoz. A Facebook elsődleges célja az emberek összekapcsolása egymással. Ebből következik, hogy irányelveik jobban tükrözik ezt a sokszínűséget, és az adott közösség biztonsága érdekében készültek, nem pedig valamiféle hírkiadási mantrát vagy üres ideológiát.

Szeretnénk, ha a Facebook átláthatóbb lenne abban, ahogyan emberek millióit és a tartalom darabjait moderálja naponta. Ezeknek a kérdéseknek a nagyobb megvilágítása segít rámutatni a problémákra, és lehetőséget ad a Facebooknak a közösség biztonságának javítására. Szeretnénk látni, hogy a Facebook jövedelmének jóval nagyobb részét szánja annak biztosítására, hogy elegendő személyzettel rendelkezzen ahhoz, hogy a platformja biztonságban legyen. Minden felhasználónak.

További információkért

Lábjegyzetek:

- Ja, és vegye figyelembe, hogy ha 100 000 további követője van a Facebookon, akkor az ő szemükben ez „közszereplővé” tesz - és nem tartozik a hétköznapi emberek magánéletének vagy egyéb védelmének hatálya alá. [↩]